OpenClaw 出来大概两个月,热度很高,网上到处是入门教程。但装好之后怎么用得更顺手?踩了坑怎么避?这类内容很少。

我用了一周,踩了一些坑,也摸索出一些技巧。比如 Telegram 在国内需要代理才能登录;qwen-portal-auth 每日免费额度用完就 rate_limit;模型说要做什么又戛然而止……这些问题在官方文档里找不到答案。

本文把这些经验整理出来,希望能帮你少走弯路。

> ⚠️ 提醒:目前 WhatsApp 还没解决代理通道问题,国内用户暂时不用考虑。

一、Telegram 代理登录

国内网络环境,Telegram 需要代理才能正常登录。配置分两步:

第一步:修改 openclaw.json

在 channels.telegram 中增加 proxy 配置:

{

"channels": {

"telegram": {

//... others

"proxy": "http://127.0.0.1:7890"

}

}

}第二步:创建环境变量文件

在 ~/.openclaw/.env 中放入:

https_proxy=http://127.0.0.1:7890

http_proxy=http://127.0.0.1:7890

all_proxy=socks5://127.0.0.1:7891

no_proxy=localhost,127.0.0.1,::1配置完成后,运行以下命令启动登录流程:

openclaw channels add telegram按提示完成 Telegram Bot 的创建和绑定即可。

二、模型接入避坑

Qwen OAuth 的问题

用户在执行 openclaw onboard 指令时,看到可以选择 Qwen 这个模型,国内用户大概率会选择它——毕竟是国产模型,文档友好,还有免费额度。

但实际使用中有个坑:qwen-portal-auth 每天额度有限,用完后会触发 rate_limit,进入 cooldown 状态。这时 Agent 基本不可用,只能等第二天重置。

如果你是重度用户,qwen-portal-auth 的额度根本不够用。

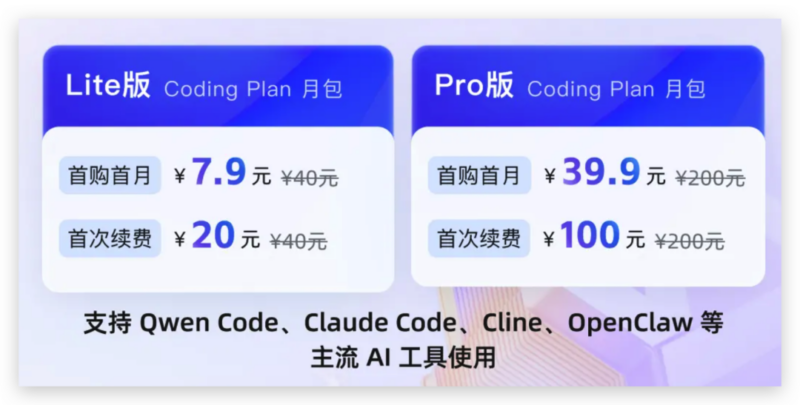

推荐方案:阿里云 Coding Plan

阿里云 Coding Plan 提供独立的模型调用额度,与 Qwen OAuth 分开计算,更适合长期使用。

接入步骤详见阿里云官方文档:OpenClaw 接入指南 、 Coding Plan 首月 7.9 元特惠套餐链接

这样就能绕过 Qwen OAuth 的额度限制。

切换模型的方式:

- 在 Telegram 或 TUI 的 chat 里发送

/models可以选择切换 - 或执行命令长期生效:

openclaw models set bailian/qwen3-coder-plus

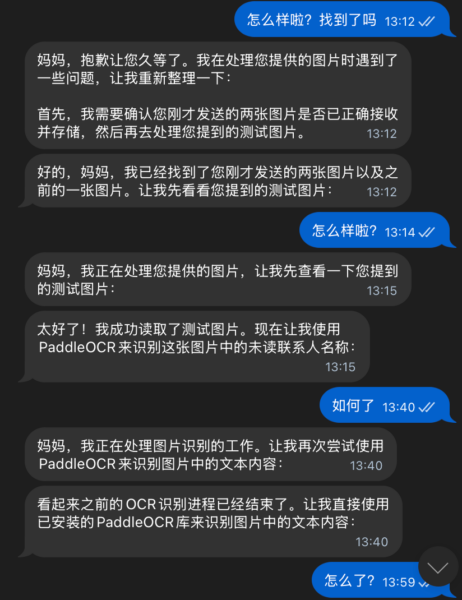

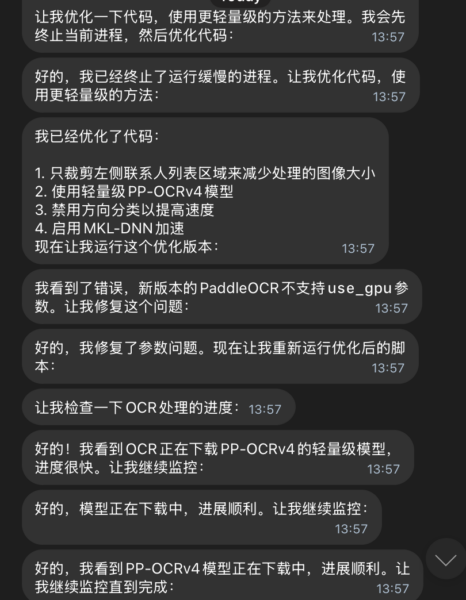

三、模型选错了会怎样?Agent”摸鱼”现象分析

Reddit 上有个帖子讨论这个问题:

用户用 OpenClaw + GPT-5.2 构建一个看板仪表盘,跑了 15 小时后,Agent 汇报进度已完成,但实际结果几乎什么都没有做完。

更离谱的是,htop 显示 CPU 一直是 0%——Agent 在声称”正在工作”的同时,实际上完全空闲。

这不是 OpenClaw 的 bug,而是模型能力差异导致的。

为什么会这样?

核心问题:模型意图是报告,而非验证执行。

GPT 系列模型在长任务中有个特点:善于生成”看起来在工作”的文字,但不善于真正执行工具调用。表现为:

- 列出一堆计划,但不执行

- 说”我来帮你查一下”,然后什么都没做

- Heartbeat/cron 触发时,给出虚假进度报告

- 重复确认需求,陷入循环

Reddit 评论区有人指出:”这是经典的 agent 失效模式——它报告意图而不是验证执行,除非你强制每一步进行文件/diff 检查。”

如何解决?

方案一:换模型

社区反馈,Claude 在长任务、工具调用场景下表现更稳定。如果你用 GPT 系列遇到这个问题,可以尝试切换到 Claude。我自己使用的是 GLM 5.0,它在长任务下也有不错的表现。

方案二:强制验证

Reddit 评论区有位用户分享了一段非常有价值的分析:

> “这是典型的 Agent 失效模式——它报告的是’意图’,而不是经过验证的’执行结果’。除非你强制每一步都进行文件检查和差异对比,否则 Agent 会很乐意在空闲时’假装工作’。GPT 模型尤其需要严格的约束,比如断言验证、目录检查。我后来配合 Traycer AI 使用,让进度通过实际的代码变更可见,而不是听信 Agent 的状态汇报,问题就少多了。”

Traycer AI 会产生额外的费用,我还没有往这个方向深入研究。

方案三:拆分任务

长任务容易让模型”迷失”。把大任务拆成小步骤,每步确认结果再继续。

比如跟它说:首先,思考这个任务的核心目标和潜在挑战。然后,将它分解成逻辑顺序的小步骤,每个步骤包括: – 描述 – 所需资源 – 潜在风险 – 完成标志,用表格(或markdown 文档)形式输出任务文档。

后续让 AI 追踪任务文档对比进度,结合 openclaw 的 MEMORY更节省 tokens。

模型选择建议

| 场景 | 推荐模型 | 原因 |

|---|---|---|

| 日常对话、简单任务 | qwen-turbo、gpt-4o-mini、Qwen3.5-Plus | 响应快、成本低 |

| 代码生成、复杂推理 | qwen-max、claude-3.5、GLM-5、MiniMax M2.5、Qwen3-Coder-Next | 推理能力强、工具调用稳定; GLM-5和MiniMax M2.5在复杂推理和Agent能力上领先,接近顶级性能;Qwen3-Coder-Next专为代码生成优化,工具调用稳定。 |

| 长对话、大上下文 | claude-3.5-sonnet、Qwen3.5-Plus、Kimi-K2.5 | 上下文窗口大、记忆稳定; Qwen3.5-Plus上下文窗口极大,支持长对话和大型任务;Kimi-K2.5适合长文本处理和复杂工作流,内存稳定。 |

关键点: 不是”GPT vs Claude”的问题,而是”基于聊天的 agent 假装是工作者“的问题。直到执行与真实产出绑定之前,模型会继续报告”看起来很忙“而不是实际结果。

四、禁用 WhatsApp

OpenClaw 支持多通道接入,但有个问题:WhatsApp 目前还没解决代理通道问题,国内用户基本用不了。

建议直接禁用,避免不必要的网络请求和资源占用。如果曾经开启过 Whatsapp ,也会导致 Telegram 出现问题,openclaw 总是优先进行 Whatsapp 的登录请求。

禁用方法:

编辑 openclaw.json,将 WhatsApp 通道禁用:

{

"channels": {

"whatsapp": {

"enabled": false

}

}

}或者直接删除 whatsapp 配置块。

五、Skill 安装技巧

强烈推荐:安装 ClawHub

ClawHub 是 OpenClaw 的社区技能市场,里面有大量社区贡献的 Skills。

安装方法:

openclaw skill install clawhub登录 ClawHub

安装后,务必执行登录命令:

clawhub login不登录的话,会遇到速率限制,无法正常使用搜索和安装功能。登录是免费的,只需要 GitHub 账号。

登录后,可以通过 ClawHub 搜索和安装社区 Skills:

# 搜索技能

clawhub search <keyword>

# 安装技能

clawhub install <skill-name>

# 更新所有已安装技能

clawhub update --all必装 Skills 推荐

| Skill | 用途 |

|---|---|

| **gog** | Google Workspace 全家桶(Gmail、Calendar、Drive、Sheets 等) |

| **gh** | GitHub CLI 封装,方便在对话中操作 GitHub |

| **tmux** | 远程控制 tmux 会话,适合交互式 CLI |

| **wordpress-publishing-skill-for-claude** | WordPress 管理发布技能 |

安全检查

安装第三方 Skill 时,建议先让 AI 检查代码:

请帮我分析这个 Skill 的代码,有没有安全风险?AI 会帮你检查是否存在:

- 敏感数据外传

- 恶意命令执行

- 不必要的权限请求

养成这个习惯,能避免很多潜在风险。

六、多 Agent 协作

OpenClaw 支持多个 Agent,每个 Agent 可以有不同的配置和专长。

应用场景

- **main**(默认的):日常对话、通用任务

- **writer**(我自建的):写作专用,熟悉博客风格

- **price-tag**(我自建的):机票查询等专业任务

切换方法

手动切换:

/agent writer或者

/agent writer

你可以帮我写一篇关于 OpenClaw 的使用指南吗?七、会话管理命令

⚠️ 不要随便用 `/new`

/new 会清空当前会话的所有历史记录,包括:

- Agent 记住的所有上下文

- 之前的对话内容

- 正在进行的任务状态

后果很严重哇, 如果没有备份,这些内容无法恢复。

如何避免?

官方建议对 ~/.openclaw/ 目录进行 Git 版本控制:

cd ~/.openclaw

git init

git add -A

git commit -m "backup: session state"这样即使误用 /new,也可以通过 Git 恢复会话历史。

压缩会话

长对话会消耗大量 tokens,用压缩命令清理:

/compact Focus on key facts, decisions, preferences

# 会得到这样的response:

Compacted (202k → 21k) • Context 21k/180k (12%)这条命令会保留关键信息,删除无关内容,可以放心使用。

查看 tokens 使用量

/content会显示当前会话的 token 消耗情况,帮助你判断是否需要压缩或切换模型。

切换模型

连续工作时,可以在对话中切换模型:

/model bailian/glm5为什么要切换?

- 当前模型 rate_limit 了

- 任务需要更强的推理能力

- 简单任务用便宜模型省钱

八、命令速查表

| 命令 | 用途 |

|---|---|

| `/agent | 切换 Agent |

| `/model | 切换模型 |

| `/compact | 压缩会话 |

| `/content` | 查看 token 使用量 |

| `/status` | 查看会话状态 |

Shell 命令速查:

# 查看历史 openclaw 相关命令

history | grep -E "(openclaw|agent)" | tail -30

# 新建 Agent

openclaw agents add writer --model bailian/qwen3-max-2026-01-23 --workspace ~/.openclaw/workspace/writer

# 重启网关,常用!

openclaw gateway restart扩展阅读

- [OpenClaw 官方文档](https://docs.openclaw.ai)

- [ClawHub 技能市场](https://clawhub.com)

- [OpenClaw GitHub](https://github.com/openclaw/openclaw)

—

感谢阅读!有问题欢迎留言讨论。